Cuando la IA deja de responder y empieza a hacer cosas

Un niño le pide a un asistente:

"Recuérdame mañana que lleve la cantimplora."

Al día siguiente, el recordatorio aparece.

La IA no solo ha contestado.

Ha hecho algo.

Ese salto parece pequeño, pero cambia mucho.

Un chatbot responde. Un agente actúa.

Un chatbot te devuelve texto.

Un agente recibe una tarea, decide pasos intermedios, usa herramientas y entrega un resultado.

No siempre lo hace bien.

No siempre entiende el contexto.

No siempre debería tener permiso para hacer lo que puede hacer.

El ayudante con permisos

Para entender un agente, no hace falta empezar por palabras técnicas.

Podemos imaginar cinco piezas:

- Un cerebro: entiende lenguaje y genera respuestas.

- Unas instrucciones: qué papel debe cumplir.

- Una memoria o contexto: qué sabe de esta tarea.

- Unas herramientas: qué puede usar.

- Unos permisos: hasta dónde puede actuar sin preguntar.

La diferencia importante está en las herramientas y los permisos.

Ejemplos cotidianos

Un agente puede:

- buscar información;

- resumir documentos;

- organizar una lista;

- crear un borrador;

- programar una pequeña app;

- revisar un archivo;

- preparar un correo;

- añadir algo a un calendario;

- ejecutar pasos hasta completar una tarea.

Pero no todos los agentes deberían poder hacer todo.

Un tutor de matemáticas no necesita enviar correos.

Un agente de cocina no necesita comprar nada sin permiso.

Un agente para niños no debería recordar datos personales innecesarios.

Por qué cambia el juego para los niños

Con un chatbot, el riesgo principal es aceptar una respuesta incorrecta.

Con un agente, el riesgo puede ser aceptar una acción incorrecta.

Una mala respuesta se lee.

Una mala acción puede borrar, enviar, comprar, publicar, cambiar o compartir algo.

Por eso los niños no solo necesitan aprender a preguntar.

Necesitan aprender a encargar, limitar y revisar.

Las tres puertas

1. Arrancar con tareas pequeñas

No pedir:

"Házmelo todo."

Pedir:

"Haz una primera lista de tres ideas."

"Resume este texto en cinco líneas."

"Crea una primera versión y espera mi revisión."

Un buen encargo a un agente debe ser pequeño, observable y reversible.

2. Entender qué puede hacer

Antes de usar un agente, conviene preguntar:

- ¿Qué herramientas tiene?

- ¿Puede buscar en internet?

- ¿Puede leer archivos?

- ¿Puede escribir o modificar cosas?

- ¿Puede enviar mensajes?

- ¿Tiene memoria?

- ¿Necesita aprobación antes de actuar?

Entender un agente es entender sus límites y permisos.

3. Dudar de lo hecho

No basta con preguntar:

"¿Está bien la respuesta?"

Hay que preguntar:

- ¿Qué ha hecho exactamente?

- ¿Qué cambió?

- ¿Dónde lo guardó?

- ¿A quién se lo envió?

- ¿Qué datos usó?

- ¿Puedo deshacerlo?

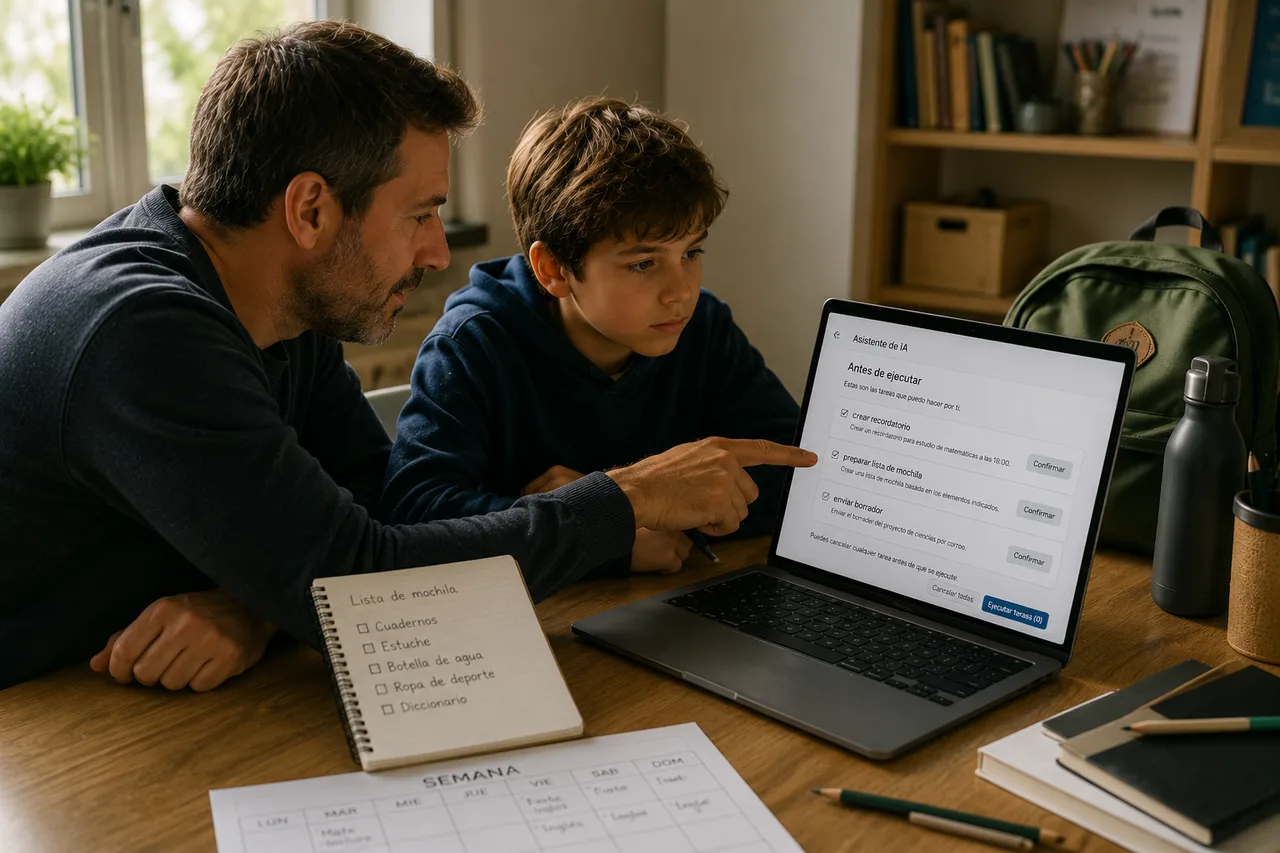

Actividad: diseña un agente de papel

Antes de usar una IA real, podemos jugar a diseñar un agente imaginario.

Por ejemplo: Agente Mochila.

Su tarea:

Ayudar a preparar la mochila del cole.

Instrucciones:

- Revisar el horario de mañana.

- Hacer una lista de cosas necesarias.

- Preguntar antes de añadir algo nuevo.

- No borrar nada sin permiso.

Herramientas:

- Horario semanal.

- Lista de materiales.

- Recordatorios.

Permisos:

- Puede sugerir.

- Puede preguntar.

- No puede comprar.

- No puede enviar mensajes.

- No puede decidir solo.

Después se conversa:

- ¿Qué pasaría si le damos demasiada memoria?

- ¿Qué pasaría si puede enviar mensajes sin preguntar?

- ¿Qué error sería fácil de cometer?

- ¿Qué debería revisar siempre un adulto?

Diseñar un agente de papel no es un ejercicio menor.

Es una forma de hacer visibles las decisiones que normalmente quedan ocultas en los productos que usamos.

Preguntas para acompañar

- ¿Qué tarea exacta le estamos dando?

- ¿Qué debería hacer primero?

- ¿Qué no debería poder hacer?

- ¿Qué información necesita?

- ¿Qué información no necesita?

- ¿Cuándo debería pedir permiso?

- ¿Cómo sabremos si lo hizo bien?

- ¿Qué parte podemos comprobar?

- ¿Qué pasaría si entiende mal la tarea?

- ¿Cómo podríamos deshacer la acción?

La idea importante

Los agentes de IA no cambian el objetivo del blog.

Lo hacen más urgente.

Si los niños van a vivir rodeados de sistemas que no solo responden, sino que actúan, necesitarán entender mejor qué están delegando.

Un mal prompt en un chatbot puede producir una mala respuesta.

Un mal encargo a un agente puede producir una mala acción.

Por eso seguimos volviendo al mismo músculo: empezar pequeño, entender la máquina, dudar con método y revisar antes de confiar.